GPT-5.4 vs Claude Opus 4.6: Qué Modelo Elegir para Coding

GPT-5.4 y Claude Opus 4.6 son los dos modelos de IA más capaces para coding en marzo de 2026. GPT-5.4 gana en SWE-bench Pro (57,7% vs ~45%), cuesta 6 veces menos y tiene una ventana de contexto de 512K tokens nativos. Claude Opus 4.6 lidera en SWE-bench Verified (80,8%), introduce menos regresiones según SWE-CI y mantiene coherencia en refactors multi-archivo. Esta guía compara ambos modelos con datos reales y propone una estrategia de model routing para elegir el correcto en cada tarea.

Los benchmarks sintéticos ya no sirven para elegir

Seis modelos de IA puntúan dentro de un margen de 0,8 puntos en SWE-bench Verified. Cuando la diferencia entre el primero y el sexto es menor que el margen de error, el benchmark ha dejado de ser útil para tomar decisiones.

El problema es estructural: SWE-bench Verified mide tareas con una mediana de 4 líneas de código cambiadas en repositorios Python conocidos. En producción, los cambios típicos implican decenas de archivos y cientos de líneas. CursorBench ya demostró que los benchmarks con uso real cuentan una historia diferente a los sintéticos.

Para comparar GPT-5.4 y Opus 4.6 de forma útil, necesitas mirar tres benchmarks complementarios: SWE-bench Pro, Terminal-Bench y SWE-CI. Cada uno expone fortalezas y debilidades que un solo número no captura.

¿Qué es SWE-bench Pro y por qué importa más que Verified?

SWE-bench Pro es un benchmark de Scale AI con 1.865 tareas en Python, Go, TypeScript y JavaScript, distribuidas en 41 repositorios reales. A diferencia de Verified, usa repositorios con licencias copyleft y código privado para minimizar la contaminación de datos de entrenamiento.

Las tareas requieren una media de 107 líneas de cambios en 4,1 archivos. Esto se acerca más a lo que un ingeniero de software hace en una jornada normal que las 4 líneas de mediana en Verified.

| Característica | SWE-bench Verified | SWE-bench Pro |

|---|---|---|

| Tareas | 500 | 1.865 |

| Lenguajes | Solo Python | Python, Go, TS, JS |

| Líneas cambiadas (mediana) | 4 | 55 |

| Archivos por tarea | ~1 | 4,1 |

| Riesgo de contaminación | Alto | Bajo |

| Mejor puntuación (mar. 2026) | ~80% | ~57% |

En otras palabras: SWE-bench Verified mide si el modelo recuerda patrones de fixes conocidos. SWE-bench Pro mide si sabe resolver problemas nuevos en código que no ha visto durante el entrenamiento.

GPT-5.4 vs Claude Opus 4.6: comparativa por benchmark

A marzo de 2026, los datos verificados de los principales benchmarks de coding muestran un patrón claro: ningún modelo domina todas las categorías.

| Benchmark | GPT-5.4 | Claude Opus 4.6 | Ganador |

|---|---|---|---|

| SWE-bench Verified | 77,2% | 80,8% | Opus 4.6 |

| SWE-bench Pro | 57,7% | ~45% | GPT-5.4 |

| Terminal-Bench 2.0 | 75,1% | 65,4% | GPT-5.4 |

| OSWorld (computer use) | 75,0% | 72,7% | GPT-5.4 |

| ARC-AGI-2 (razonamiento) | - | 68,8% | Opus 4.6 |

| MRCR v2 (contexto largo) | - | 76% | Opus 4.6 |

GPT-5.4 gana en las categorías que miden amplitud: tareas de terminal, interacción con escritorio y coding multi-lenguaje en repositorios no contaminados. Opus lidera donde la profundidad importa: razonamiento complejo, comprensión de contexto largo y precisión en repositorios conocidos.

SWE-CI: el benchmark que expone las regresiones

SWE-CI, publicado por investigadores de la Universidad Sun Yat-sen y Alibaba en marzo de 2026, mide algo que los otros benchmarks ignoran: si un agente de IA mantiene código funcional a lo largo del tiempo sin romper lo que ya funciona.

Cada una de las 100 tareas corresponde a la evolución real de un repositorio Python, con una media de 233 días y 71 commits consecutivos. El agente debe resolver cada commit sin romper los tests existentes.

El resultado es contundente: el 75% de los modelos evaluados rompen código que funcionaba. La métrica clave es la tasa de zero-regression, la proporción de tareas donde el modelo no introduce ninguna regresión en todo el ciclo:

- Claude Opus 4.6: 0,76 (el mejor resultado con diferencia)

- Claude Opus 4.5: 0,51

- Resto de modelos evaluados: por debajo de 0,25

Esto tiene implicaciones directas para equipos de producto. Como se evidencia al construir agentes IA en producción, un agente que resuelve el ticket de hoy pero introduce regresiones que descubrirás el próximo sprint no ahorra tiempo de ingeniería. Está pidiendo prestado del futuro a un interés alto.

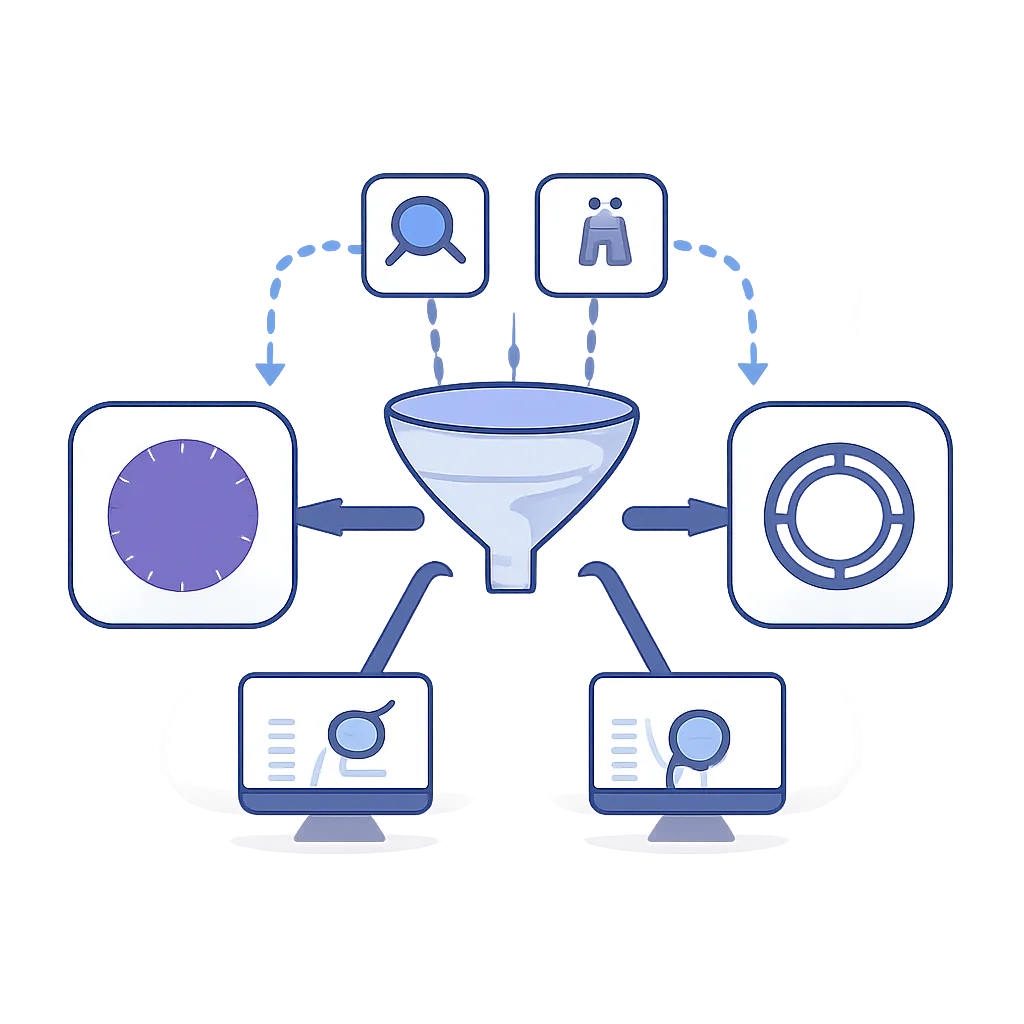

Cuándo usar cada modelo: estrategia de model routing

El patrón que funciona en equipos de producto es model routing: derivar cada tarea al modelo que mejor la resuelve según tipo y complejidad. A marzo de 2026, es una práctica cada vez más estándar en equipos que integran IA en su flujo de desarrollo.

Usa Claude Opus 4.6 cuando:

- Refactors multi-archivo: cambios que tocan tipos, interfaces y dependencias entre módulos. Opus mantiene coherencia donde GPT-5.4 pierde el hilo en codebases a partir de ~30K líneas.

- Código crítico sin margen de error: la tasa de zero-regression de 0,76 en SWE-CI significa menos sorpresas en producción.

- Razonamiento profundo: arquitectura de sistemas, depuración de flujos complejos, análisis de dependencias. El debugging de aplicaciones LLM es un ejemplo donde la profundidad de razonamiento marca la diferencia.

- Contexto largo con alta precisión: 76% en MRCR v2 para recuperación de información en contextos de hasta 1M de tokens.

Usa GPT-5.4 cuando:

- Tareas de terminal y DevOps: Terminal-Bench muestra un 75,1% vs 65,4%. Scripts de despliegue, automatización bash, gestión de servidores.

- Bugs aislados y fixes rápidos: las tareas de SWE-bench Pro con cambios en pocos archivos favorecen a GPT-5.4 por velocidad y coste.

- Computer use: primer modelo que supera el rendimiento humano en OSWorld (75% vs 72,4% humano). Depuración visual de web apps, automatización de UI.

- Presupuesto limitado: a 6x menos coste que Opus, para tareas del día a día el ahorro es significativo.

Usa Claude Sonnet 4.6 como default:

A ~2,75€/13,80€ por millón de tokens, Sonnet 4.6 es el modelo más eficiente para tareas de complejidad media: code review, generación de tests, documentación técnica. La guía de herramientas de coding IA en 2026 detalla cómo integrar Sonnet en tu flujo diario.

Ejemplo de routing con LiteLLM

import os

from litellm import completion

# ANTHROPIC_API_KEY y OPENAI_API_KEY en variables de entorno

def route_coding_task(

task: str,

files_affected: int,

is_critical: bool = False,

) -> str:

"""Enruta tareas de coding al modelo optimo."""

if is_critical or files_affected > 5:

# Refactors complejos, codigo critico

model = "anthropic/claude-opus-4-6"

elif files_affected > 1:

# Tareas multi-archivo no criticas

model = "openai/gpt-5.4"

else:

# Tareas simples, code review, docs

model = "anthropic/claude-sonnet-4-6"

response = completion(

model=model,

messages=[{"role": "user", "content": task}],

temperature=0, # Determinista para coding

)

return response.choices[0].message.content

# Ejemplo de uso

fix = route_coding_task(

task="Refactoriza el modulo auth para usar OAuth2 con PKCE",

files_affected=8,

is_critical=True,

)

# Resultado: usa Opus 4.6 (multi-archivo + critico)

El output esperado es que LiteLLM seleccione anthropic/claude-opus-4-6 para esta tarea (8 archivos + flag crítico). Para un fix de un solo archivo sin flag crítico, seleccionaría anthropic/claude-sonnet-4-6.

En Producción

Los benchmarks orientan la decisión. La producción la valida. Estas son las consideraciones que cambian al salir del tutorial.

Costes reales

| Modelo | Input (por M tokens) | Output (por M tokens) | Coste mensual estimado* |

|---|---|---|---|

| GPT-5.4 | ~2,30€ | ~13,80€ | 15-30€ |

| Claude Opus 4.6 | ~13,80€ | ~69€ | 80-200€ |

| Claude Sonnet 4.6 | ~2,75€ | ~13,80€ | 20-40€ |

* Estimación para un desarrollador individual con uso moderado diario. Conversión aproximada USD a EUR a marzo de 2026.

GPT-5.4 usa un 47% menos de tokens que su predecesor en tareas complejas. Combinado con el precio inferior, una tarea que cuesta 1€ con Opus puede costar 0,10-0,15€ con GPT-5.4. Pero si esa tarea introduce una regresión que cuesta 2 horas de debugging, el ahorro desaparece.

Límites de contexto

GPT-5.4 ofrece 512K tokens nativos (1M en modo Codex). Opus 4.6 tiene 200K estándar con 1M en beta restringido a planes de alto consumo. Más contexto no siempre significa mejores resultados: la attention dilution degrada la precisión en contextos largos. La regla práctica: usa el mínimo contexto necesario para la tarea.

Latencia y flujo de trabajo

GPT-5.4 genera tokens de forma consistente más rápida. Para flujos interactivos (autocompletado en IDE, fixes rápidos), la latencia importa más que la calidad marginal. Para tareas batch como refactors nocturnos o análisis de codebase, la calidad manda sobre la velocidad.

Errores comunes al elegir modelo

Error: Usar Opus 4.6 para todo porque "es mejor en coding".

Causa: Opus lidera SWE-bench Verified, pero no todas las tareas de coding requieren esa profundidad. Para fixes de 1-2 archivos, GPT-5.4 es más rápido y 6x más barato sin pérdida de calidad perceptible.

Solución: Implementa routing por complejidad. Opus solo para tareas multi-archivo o código crítico.

Error: Comparar modelos solo con SWE-bench Verified.

Causa: SWE-bench Verified tiene alta contaminación de datos y una mediana de 4 líneas cambiadas. No refleja trabajo de ingeniería real.

Solución: Complementa con SWE-bench Pro (multi-lenguaje, multi-archivo) y SWE-CI (regresiones a largo plazo) para una imagen completa.

Error: Ignorar las regresiones porque "pasan los tests".

Causa: SWE-CI demuestra que el 75% de los modelos rompen código existente incluso cuando sus patches pasan todos los tests inmediatos.

Solución: Ejecuta la suite de tests completa, no solo los tests del ticket. Opus 4.6 tiene la tasa de zero-regression más alta (0,76), pero ningún modelo garantiza cero regresiones.

Preguntas frecuentes

¿Puedo usar GPT-5.4 y Claude Opus 4.6 juntos en el mismo proyecto?

Sí, y es la estrategia que más equipos están adoptando en 2026. El patrón multi-CLI con MCP permite combinar Claude, Codex y Gemini en un solo flujo de trabajo. Usa LiteLLM como capa de abstracción para unificar las APIs y enrutar por complejidad de tarea.

¿Merece la pena pagar 6x más por Opus 4.6?

Depende de la tarea. Para refactors que tocan más de 5 archivos, Opus mantiene coherencia donde GPT-5.4 pierde contexto. Para fixes aislados y tareas de terminal, GPT-5.4 ofrece calidad comparable a una fracción del coste. La clave es no usar el modelo premium para todo.

¿Qué modelo elegir si solo puedo pagar uno?

GPT-5.4. Es el mejor generalista, cuesta menos y cubre el 80% de las tareas de coding con calidad suficiente para la mayoría de proyectos. Si tu trabajo diario implica refactors complejos en codebases grandes, entonces Opus 4.6 justifica la inversión adicional.

Hemos visto cómo GPT-5.4 y Claude Opus 4.6 se complementan más de lo que compiten. Los benchmarks sintéticos como SWE-bench Verified ya no discriminan entre modelos, pero SWE-bench Pro y SWE-CI revelan diferencias reales: GPT-5.4 resuelve más tareas complejas multi-lenguaje, Opus introduce menos regresiones a lo largo del tiempo.

La estrategia ganadora no es elegir un modelo, sino enrutar cada tarea al correcto. Opus para la precisión en refactors críticos, GPT-5.4 para el trabajo del día a día, Sonnet 4.6 como default eficiente. El coste combinado de esta estrategia es menor que usar Opus para todo, y la calidad es mayor que usar solo GPT-5.4.

¿Ya usas model routing en tus proyectos? Cuéntame qué combinación te funciona en Twitter @sergiomarquezp_.