Introducción a las Redes Neuronales Convolucionales (CNN): Fundamentos y Aplicaciones para Principiantes

¿Qué son las Redes Neuronales Convolucionales?

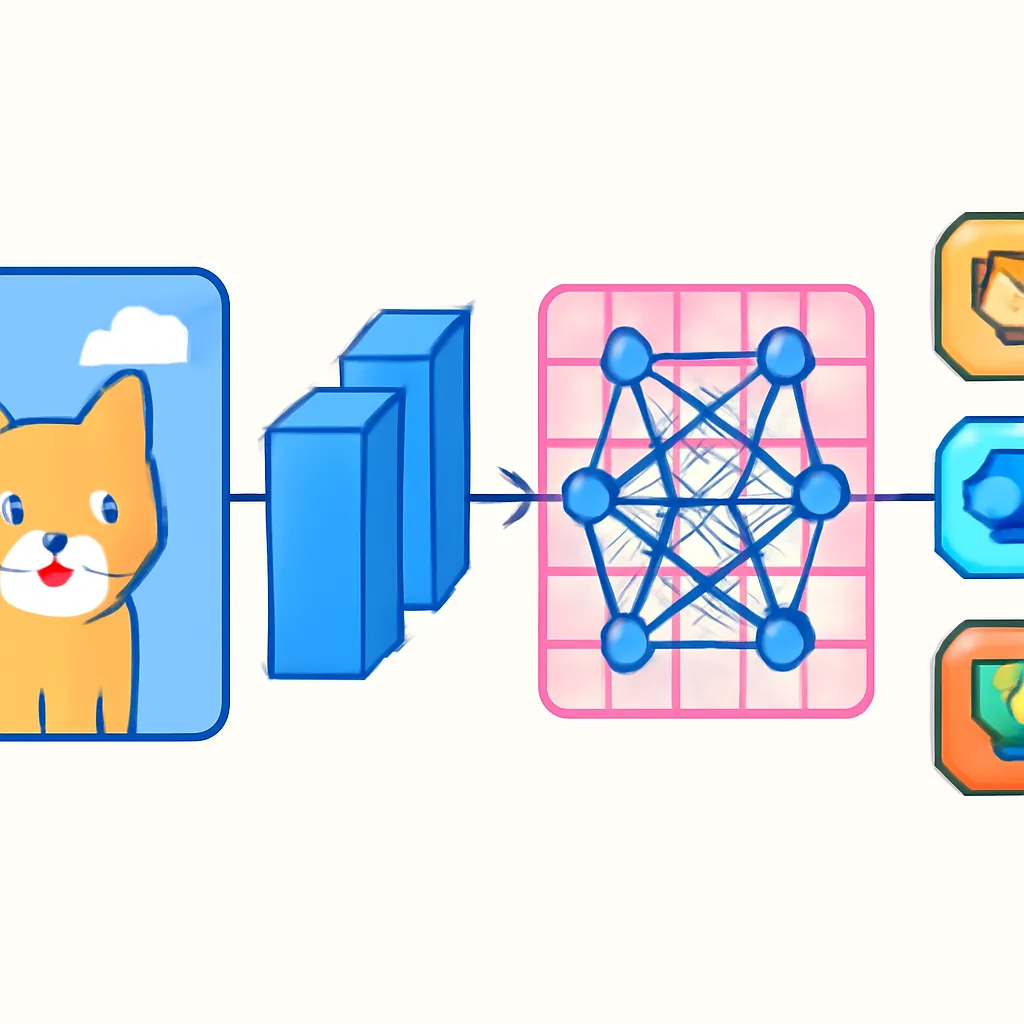

Las Redes Neuronales Convolucionales, conocidas como CNN por sus siglas en inglés (Convolutional Neural Networks), son un tipo especializado de redes neuronales diseñadas especialmente para procesar datos con una estructura de tipo cuadrícula, como las imágenes. Su capacidad para capturar patrones espaciales las hace fundamentales en el campo de la Inteligencia Artificial aplicada a la visión por computadora.

Conceptos Clave y Arquitectura Básica

La característica principal de las CNN es la operación de convolución, que permite detectar características locales en la imagen, como bordes, texturas y formas. A diferencia de las redes neuronales tradicionales (fully connected), las CNN reducen drásticamente la cantidad de parámetros, mejorando la eficiencia y el poder de generalización.

Componentes esenciales de una CNN:

- Capa Convolucional: Aplica filtros (o kernels) que escanean la imagen para extraer características locales.

- Capa de Activación: Introduce no linealidades, siendo la función ReLU (Rectified Linear Unit) la más común.

- Capa de Pooling: Reduce dimensionalidad, resumiendo regiones para hacer el modelo más eficiente y resistente a pequeñas transformaciones.

- Capa Fully Connected: Al final de la red, se conecta con todas las neuronas para hacer la clasificación o regresión.

¿Cómo funcionan las capas convolucionales?

En la convolución, se pasa un filtro (matriz pequeña de pesos) sobre la imagen de entrada para obtener mapas de características. Cada filtro está especializado en detectar un patrón específico.

Ejemplo de operación convolucional sobre una imagen.

Ejemplo de operación convolucional sobre una imagen.

Esta operación se repite con múltiples filtros para extraer diferentes tipos de características. Los parámetros del filtro se aprenden automáticamente durante el entrenamiento.

Ejemplo sencillo con Python y Keras

A continuación, una red neuronal convolucional básica para clasificación de imágenes sobre el conjunto MNIST de dígitos escritos a mano.

import tensorflow as tf

from tensorflow.keras import layers, models

# Cargar dataset MNIST

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

# Normalizar y adaptar dimensiones

x_train = x_train.reshape(-1, 28, 28, 1).astype('float32') / 255.0

x_test = x_test.reshape(-1, 28, 28, 1).astype('float32') / 255.0

# Construcción del modelo

model = models.Sequential([

layers.Conv2D(32, kernel_size=(3,3), activation='relu', input_shape=(28,28,1)),

layers.MaxPooling2D(pool_size=(2,2)),

layers.Conv2D(64, kernel_size=(3,3), activation='relu'),

layers.MaxPooling2D(pool_size=(2,2)),

layers.Flatten(),

layers.Dense(128, activation='relu'),

layers.Dense(10, activation='softmax')

])

# Compilación

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# Entrenamiento

model.fit(x_train, y_train, epochs=5, validation_split=0.1)

# Evaluación

loss, accuracy = model.evaluate(x_test, y_test)

print(f'Precisión en test: {accuracy:.2f}')

Este código muestra un pipeline simplificado para entrenar una CNN desde cero y entender el principio básico del aprendizaje de características con convoluciones.

Aplicaciones Prácticas de las CNN

Las CNN se usan ampliamente en muchas áreas, incluyendo:

- Visión por Computadora: Clasificación de imágenes, detección de objetos, segmentación semántica.

- Procesamiento de Video: Seguimiento de objetos, reconocimiento de acciones.

- Medicina: Detección de enfermedades en imágenes médicas como radiografías o resonancias magnéticas.

- Automoción: Vehículos autónomos que identifican señales de tránsito o peatones.

Ventajas y Limitaciones

- Ventajas: Capacidad de extraer automáticamente características útiles, buena generalización, menos parámetros que redes densas.

- Limitaciones: Necesidad de grandes volúmenes de datos etiquetados, alto costo computacional para redes profundas, dificultad para relacionar contexto global debido a receptive fields limitados.

Conclusión

Las Redes Neuronales Convolucionales son el pilar en el campo de la visión artificial y un buen punto de entrada para quienes desean incursionar en modelos de Deep Learning aplicados a imágenes. Comprender su funcionamiento básico y experimentar con ejemplos prácticos como el que presentamos es esencial para construir bases sólidas. A medida que avances, podrás explorar innovaciones como transfer learning, arquitecturas preentrenadas (ResNet, VGG, EfficientNet) y técnicas avanzadas para optimización y despliegue.