OmniCoder-9B: El LLM para Programar en tu GPU de 12GB

TL;DR / RESUMEN EJECUTIVO

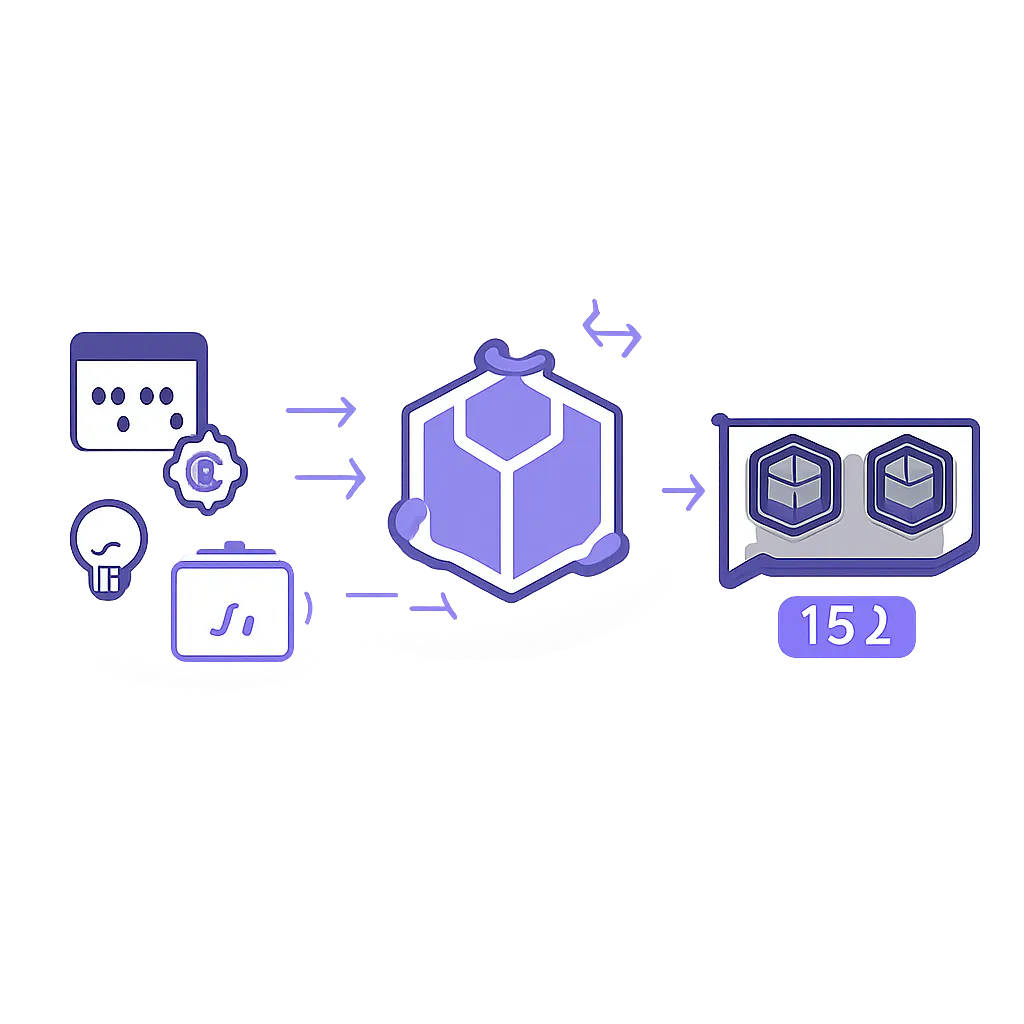

OmniCoder-9B es un modelo de lenguaje de 9.000 millones de parámetros, basado en Qwen3.5-9B, y ha sido afinado (fine-tuned) específicamente para tareas de programación agéntica. Su importancia radica en que demuestra cómo modelos más pequeños y especializados, entrenados con "trayectorias agénticas" (secuencias de razonamiento, uso de herramientas y comandos de terminal), pueden superar a modelos más grandes y generalistas en hardware de consumo como una NVIDIA RTX 3060. En este artículo, veremos cómo funciona, su rendimiento real y por qué este enfoque de entrenamiento está cambiando las reglas del juego para el desarrollo de IA en local.

El problema: Agentes de IA potentes, pero en la nube

Hasta hace poco, la conversación sobre agentes de IA capaces de escribir código de forma autónoma estaba dominada por modelos gigantescos que solo podíamos usar a través de una API. Esto implica costes por cada llamada, latencia y, para muchos, una barrera en cuanto a la privacidad de los datos. La alternativa era usar modelos locales más pequeños, que a menudo carecían de la capacidad de razonamiento necesaria para tareas complejas de ingeniería de software.

En mi experiencia, el salto de un simple autocompletado a un verdadero agente de IA es enorme. No se trata solo de generar código, sino de entender un plan, usar herramientas (como `ls`, `grep` o `git`), leer ficheros, analizar errores y corregir el rumbo. Esta capacidad, hasta ahora, parecía reservada para los LLMs que requieren hardware muy específico y caro. OmniCoder-9B llega para desafiar esa idea.

Conceptos Clave

¿Qué es OmniCoder-9B?

OmniCoder-9B es un modelo de 9.000 millones de parámetros desarrollado por Tesslate. No es un modelo creado desde cero, sino un fine-tuning del ya competente Qwen3.5-9B de Alibaba. La clave de su rendimiento no está solo en su tamaño o arquitectura base, sino en el dataset con el que fue entrenado.

¿Qué es una "Trayectoria Agéntica"?

Una trayectoria agéntica es una grabación detallada de todos los pasos que un agente de IA toma para resolver una tarea. No es solo el código final, sino todo el proceso intermedio: el razonamiento, las llamadas a herramientas, los comandos ejecutados en la terminal y las observaciones resultantes. OmniCoder-9B fue entrenado con más de 425.000 de estas trayectorias, generadas por modelos de frontera como Claude Opus y GPT-5.4. Esto le enseña al modelo el "cómo" se resuelve un problema de software, no solo el "qué" código escribir.

Arquitectura y Entrenamiento: La Receta del Éxito

OmniCoder-9B hereda la arquitectura híbrida de Qwen3.5-9B, que combina redes "Gated Delta Networks" con atención estándar. Esta estructura es eficiente para procesar contextos largos, y OmniCoder-9B soporta una ventana nativa de 262.144 tokens. Pero la verdadera magia está en el dataset de entrenamiento.

Al entrenarse con trayectorias reales, el modelo aprende patrones de comportamiento de un desarrollador experimentado:

- Recuperación de errores: Aprende a leer un fichero antes de intentar escribir en él o a reaccionar a diagnósticos de un servidor de lenguaje (LSP).

- Uso de herramientas: Interioriza el flujo de trabajo de usar la terminal para explorar el sistema de ficheros o gestionar el control de versiones.

- Razonamiento multi-paso: Descompone problemas complejos en subtareas más pequeñas, utilizando etiquetas

<think>...</think>para articular su plan.

Rendimiento en Hardware Real: La Prueba de Fuego

La promesa de OmniCoder-9B es ofrecer un rendimiento agéntico de alto nivel en hardware accesible. Los informes de la comunidad son prometedores: usuarios con GPUs como la NVIDIA GeForce RTX 3060 de 12 GB de VRAM están consiguiendo ejecutar el modelo de forma fluida para tareas de programación. En foros como Reddit, algunos usuarios con GPUs de 8GB de VRAM reportan velocidades de hasta 40 tokens por segundo usando cuantizaciones como Q4_K_M con `llama.cpp`.

En benchmarks específicos para agentes, como Terminal-Bench 2.0, OmniCoder-9B muestra una mejora del 61% sobre su modelo base (Qwen3.5-9B), demostrando que el fine-tuning en trayectorias agénticas tiene un impacto directo y medible.

# Ejemplo de cómo ejecutar OmniCoder-9B con llama.cpp en una GPU compatible

# Asume que tienes el modelo en formato GGUF (ej. omnicoder-9b-q4_k_m.gguf)

./server -m ./models/omnicoder-9b-q4_k_m.gguf -ngl 35 -c 100000

# -m: ruta al modelo

# -ngl: número de capas a descargar en la GPU (ajustar según tu VRAM)

# -c: tamaño del contexto

En Producción

Adoptar un modelo como OmniCoder-9B para tareas de desarrollo en un entorno real tiene implicaciones directas y prácticas.

- Costes: El cambio más evidente es la reducción de costes. Pasar de un modelo basado en API, con un coste por token, a un modelo local elimina por completo este gasto operativo. Para un desarrollador o un equipo pequeño, esto puede significar un ahorro de entre 20€ y 100€ al mes, dependiendo del uso.

- Latencia y Privacidad: Al ejecutarse localmente, la latencia se reduce drásticamente. No hay esperas de red, lo que hace que la interacción sea más fluida. Además, el código fuente nunca abandona tu máquina, un requisito indispensable para empresas con políticas de privacidad estrictas.

- Especialización vs. Generalización: Es crucial entender que OmniCoder-9B no es un reemplazo de GPT-4 para todas las tareas. Es un modelo especializado. Su fortaleza reside en el ciclo de desarrollo de software. Para tareas de razonamiento general o creatividad fuera del ámbito del código, los modelos más grandes seguirán teniendo ventaja. Como explico en mi artículo sobre la jerarquía de agentes en producción, la clave es usar la herramienta adecuada para cada trabajo.

- Estabilidad: Al ser un modelo afinado sobre Qwen3.5-9B, puede heredar algunas de sus peculiaridades. Se han reportado casos aislados donde el modelo base ha tenido comportamientos inesperados. Es fundamental integrarlo en flujos de trabajo donde sus acciones estén supervisadas y, sobre todo, versionadas con Git.

Errores Comunes y Depuración

Error: El modelo genera código, pero no intenta usar herramientas de terminal (como `ls` o `cat`) para explorar el entorno.

Causa: El prompt inicial no está formulado para activar el comportamiento agéntico. El modelo no ha recibido la instrucción de "pensar" y planificar sus acciones.

Solución: Estructura tu prompt inicial para que incluya un plan de acción o una directiva explícita para que razone sus pasos. Usar un formato que imite las trayectorias de su entrenamiento, pidiéndole que piense paso a paso, suele dar mejores resultados.

Error: El rendimiento es bajo (pocos tokens por segundo) en una GPU que debería ser suficiente.

Causa: La configuración de `llama.cpp` u otro inferenciador no está optimizada. Puede que no se estén descargando suficientes capas del modelo a la VRAM de la GPU (`-ngl`).

Solución: Asegúrate de que el parámetro `-ngl` (number of GPU layers) esté configurado a un valor alto (ej. 35 o más para una GPU de 12GB), sin que exceda la memoria disponible. Experimentar con este valor es clave para encontrar el punto óptimo entre velocidad y uso de memoria.

Preguntas Frecuentes (FAQ)

¿Necesito una GPU de 128GB para usar OmniCoder-9B?

No. A diferencia de los modelos más grandes, OmniCoder-9B está diseñado para funcionar eficientemente en hardware de consumo. Una GPU con 12GB de VRAM, como una RTX 3060, es suficiente para ejecutar versiones cuantizadas del modelo a buena velocidad.

¿Es OmniCoder-9B un reemplazo de GitHub Copilot o Cursor?

No directamente. Herramientas como Copilot o Cursor están integradas en el editor como asistentes. OmniCoder-9B es el "motor" que puede potenciar a un agente autónomo. Mientras que Copilot sugiere fragmentos de código, un agente impulsado por OmniCoder-9B podría recibir una tarea completa (ej. "implementa la autenticación de usuarios") y ejecutarla de principio a fin. Son herramientas complementarias, como exploro en mi guía para elegir un asistente de código.

¿Puedo hacer fine-tuning de OmniCoder-9B con mis propias trayectorias?

Sí. Dado que los pesos del modelo son abiertos (licencia Apache 2.0), es posible realizar un fine-tuning adicional sobre OmniCoder-9B. Si un equipo registra sus propias trayectorias de desarrollo, podría especializar aún más el modelo para que se adapte a su codebase, sus herramientas internas y sus convenciones de estilo.

Hemos visto cómo OmniCoder-9B representa un cambio de paradigma. Ya no se trata de tener el modelo más grande, sino el mejor entrenado para una tarea específica. Al enfocarse en trayectorias agénticas, este modelo demuestra que la inteligencia no solo reside en el conocimiento bruto, sino en la capacidad de aplicar un proceso. La clave está en enseñar a los modelos no solo a escribir código, sino a comportarse como ingenieros de software.

Este avance abre la puerta a tener agentes de desarrollo verdaderamente capaces corriendo en nuestras máquinas locales, cambiando radicalmente nuestro flujo de trabajo diario.

¿Has probado a correr un agente de código en tu máquina local? Cuéntame tu experiencia y tu configuración en Twitter @sergiomarquezp_.