Arquitecturas Avanzadas de Modelos de Lenguaje Grandes (LLMs): Explorando Mixture of Experts y Modelos Multimodales

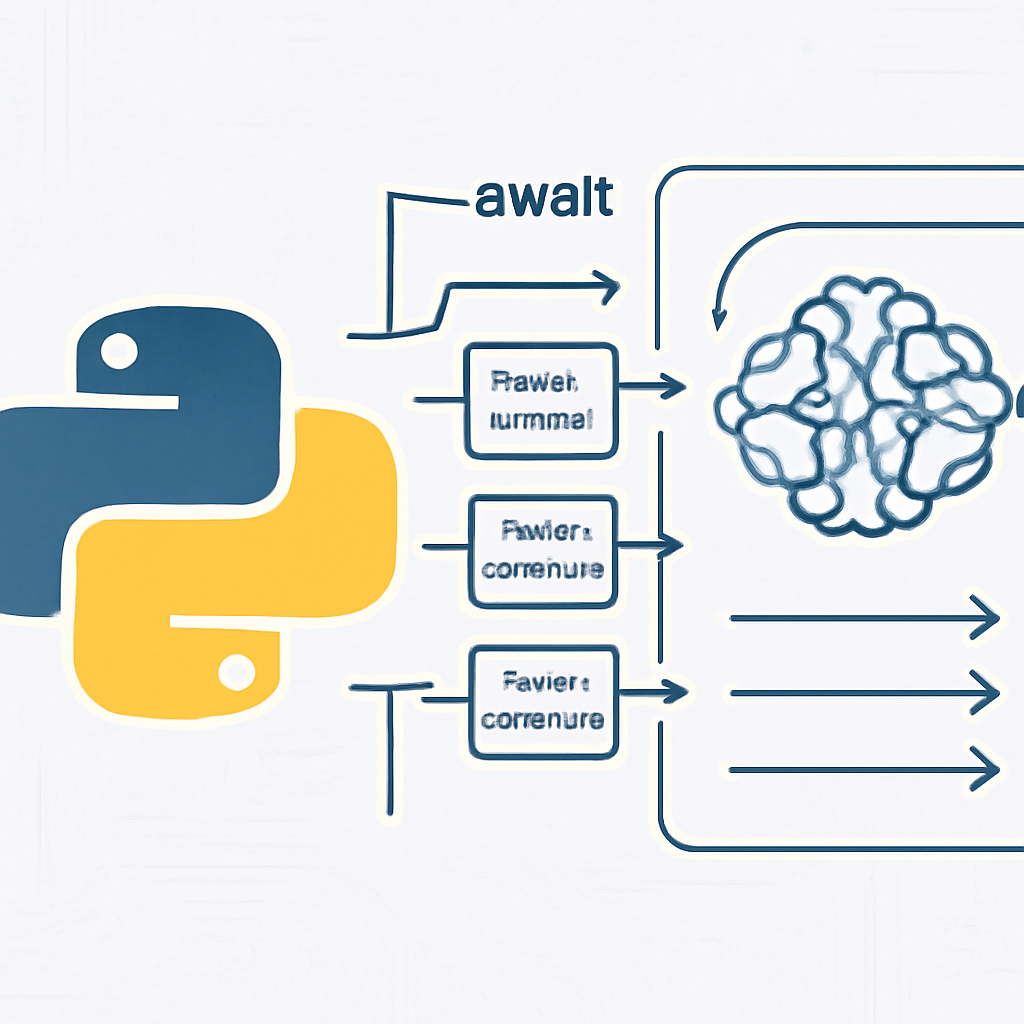

Este artículo aborda dos paradigmas arquitectónicos clave para optimizar y escalar Modelos de Lenguaje Grandes (LLMs): la arquitectura Mixture of Experts (MoE) que permite la activación selectiva de expertos especializados para mejorar la eficiencia ...